Qui diria en el passat que seria la mateixa Apple que revelaria algunes funcions noves del seu pròxim sistema operatiu abans de ser presentades. En concret, els de Cupertino es van llançar a presentar funcions relacionades amb accessibilitat. Una interfície anomenada «Accés assistit», a més que es tindran altres característiques relacionades amb la veu. L'any passat també va anunciar una sèrie de novetats prèvies a la WWDC relacionades amb accessibilitat.

Funcions d'accessibilitat a iOS 17 per a iPhone i iPad revelades per Apple

L'accés assistit funcionarà per a usuaris que tinguin algun tipus de discapacitat cognitiva. S'empren innovacions en el disseny en les apps i experiències incloses en les característiques que poden alleugerir la càrrega cognitiva, descriu Apple en la presentació. Ajudarà principalment amb les funcions més utilitzades: connectar-se amb els seus familiars i éssers estimats, fer i visualitzar fotos a més d'escoltar música.

L'experiència serà tal qual simplificada per ser més simple i intuïtiva. Serà a través d'una sola app per accedir a trucades de veu, FaceTime d'àudio i vídeo. Els botons són d'alt contrast i tenen una mida de text més gran. També existeixen eines destinades a «col·laboradors de confiança», per la qual cosa una persona pot donar suport al seu familiar amb l'iPhone o l'iPad a través d'aquestes eines.

Una altra funció anomenada «Live Speech» permetrà als usuaris escriure el que desitgen dir, el mateix que es dirà en veu alta en trucades de veu i FaceTime. També està fet per conversar amb una persona de manera física. Es poden crear i desar frases comunes per poder invocar-les en una xerrada ràpida.

Apple va pensar en els usuaris que poden perdre la parla i amb discapacitats visuals

Crear una veu per a persones que comencen a perdre la parla

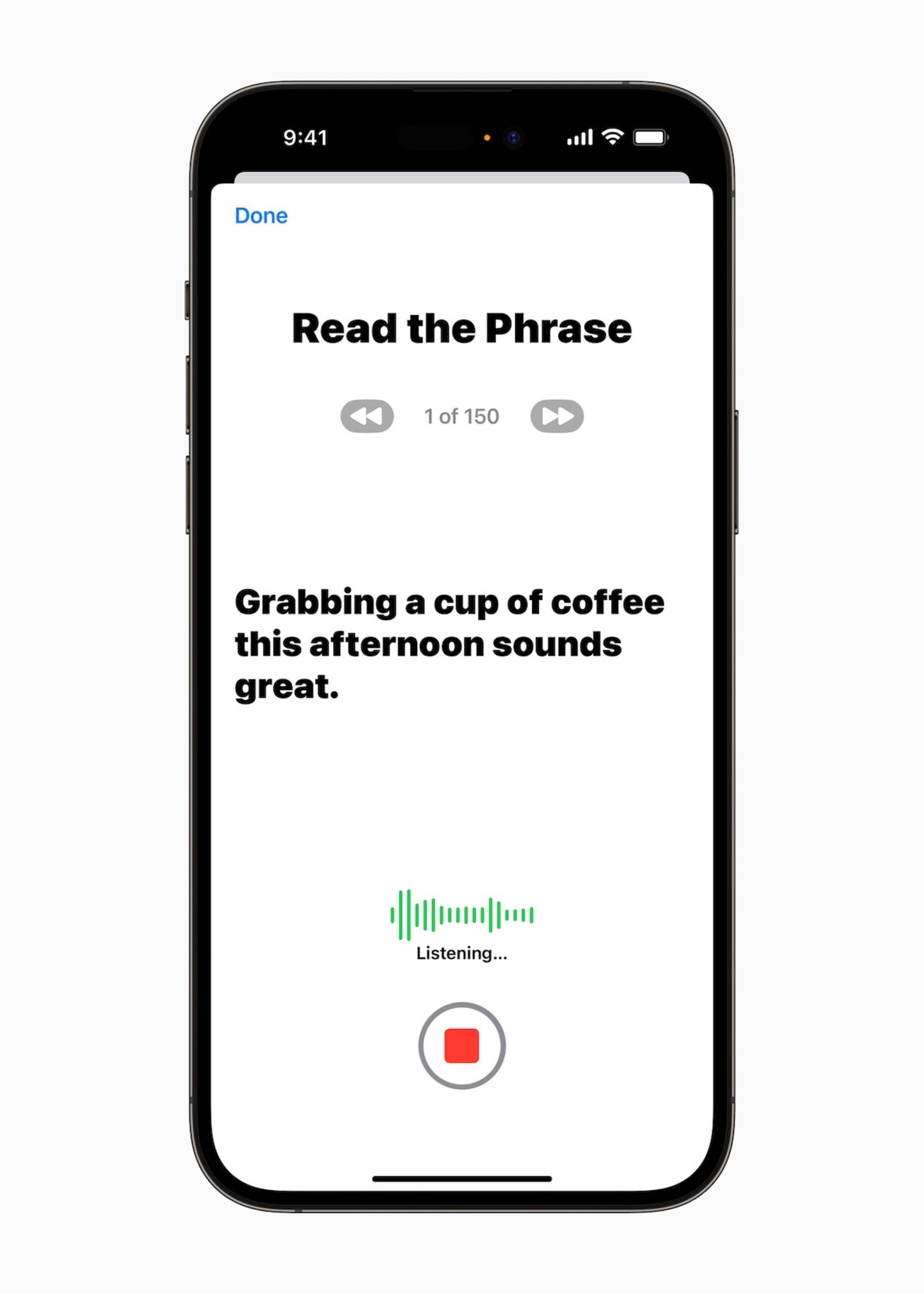

«Personal Voice», una funció també presentada el dia d'avui està feta per a usuaris que corren el risc de perdre la capacitat de parla. Ells podran crear una veu que soni tal com ells desitgin. Per a usuaris que tenen diagnòstic d'ELA (esclerosi lateral amiotròfica) o una altra malaltia que els afecti la parla, Personal Voice estarà present per assistir-los quan sigui necessari.

La veu creada serà a partir de la lectura de petits fragments aleatoris de text. Es gravaran al voltant de 15 minuts d'àudio i s'emprarà «Machine Learning» perquè la informació dels usuaris sigui privada i segura. Aquesta creació podrà usar-se en el moment en què es connectin a alguna trucada o FaceTime.

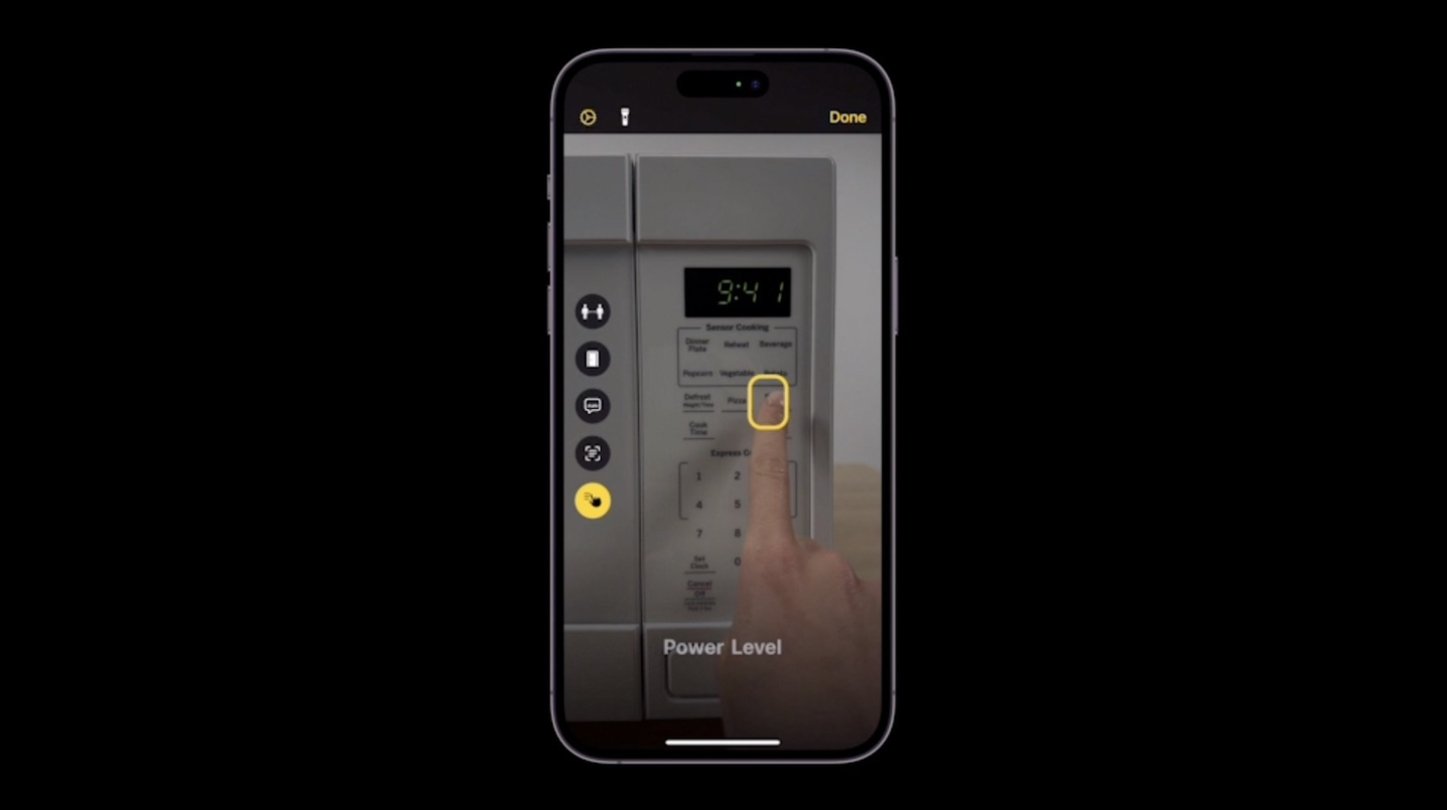

Una altra funció important és «Point and Speak in Magnifier», servirà perquè usuaris que tinguin alguna discapacitat visual puguin interactuar amb objectes físics en etiquetar-los. Per exemple, en utilitzar un electrodomèstic, la funció combinarà la càmera, l'escàner LiDAR i Machine Learning per anunciar en text el que l'usuari mou amb el seu dit a través de la pròpia pantalla. La funció es combinarà amb VoiceOver i també es barrejarà amb altres funcions llançades anteriorment com la detecció de portes, persones i descripcions d'imatges.

Point and Speak, nova funció d'accessibilitat a iOS 17

Si vols consultar totes les novetats al detall pots consultar el comunicat de premsa llançat pels de Cupertino fa unes hores. Apple sempre a l'avantguarda en qüestions d'accessibilitat, els dispositius d'Apple ho demostren dia a dia.