Apple acaba d'anunciar que el seu polèmic escaneig de les fotos d'iCloud en cerca de possibles abusos infantils es retarda i que "prendran un temps addicional" per millorar la tecnologia abans de llançar-la al públic. En una declaració a 9to5Mac, representants de la companyia han revelat aquest retard en una eina que es va presentar fa només unes setmanes.

Apple no escanejarà les teves fotos per ara

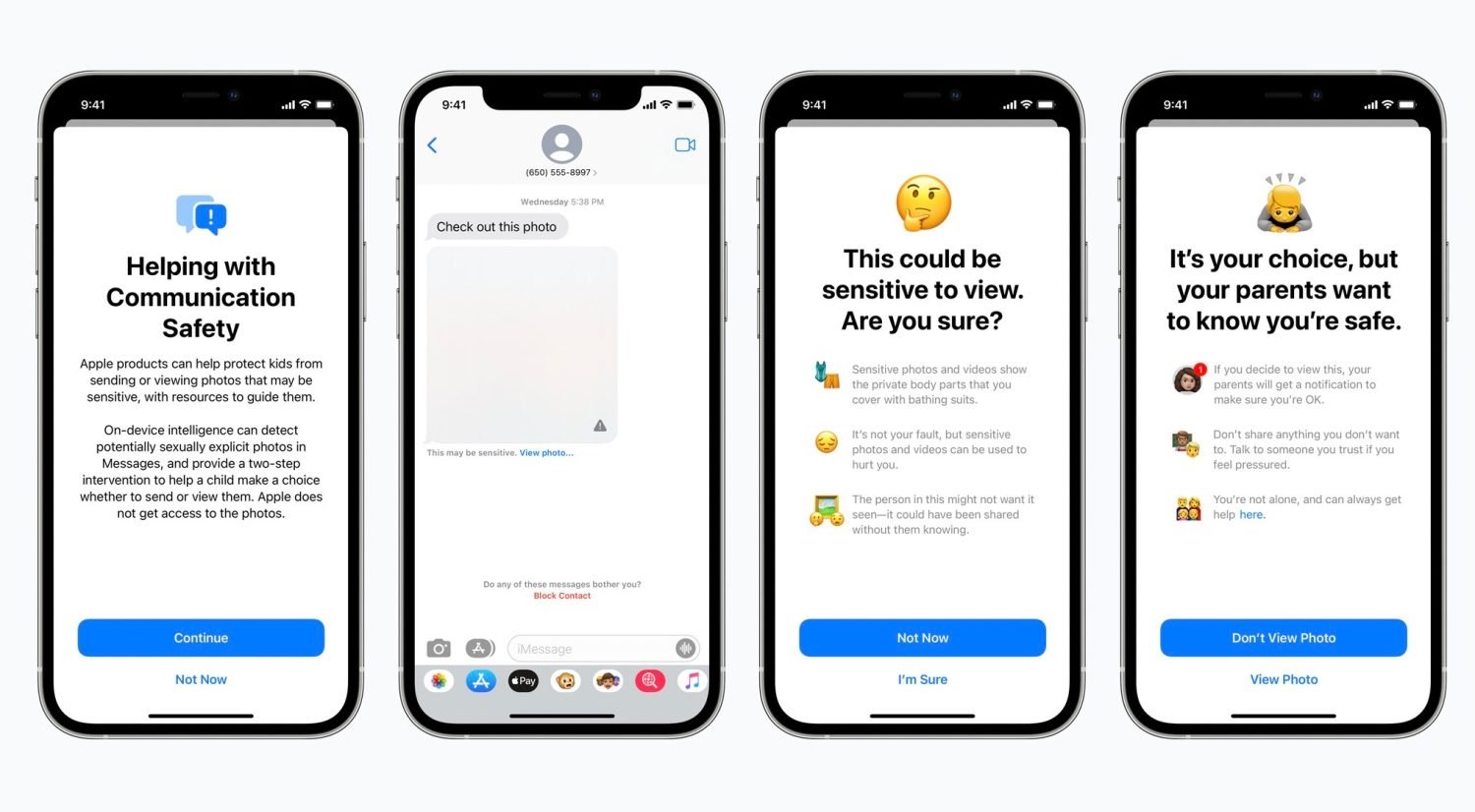

Apple va anunciar aquesta funció a principis d'agost i estava destinada a protegir els nens de possibles depredadors que utilitzessin dispositius d'Apple per trobar-los, tot tenint en compte la privadesa dels usuaris. No obstant això, és una funció que molts usuaris i experts van criticar. I sembla que amb raó ja que ara Apple ha decidit retardar aquesta novetat fins a millorar la tecnologia.

"El mes passat vam anunciar plans de característiques destinades a ajudar a protegir els nens dels depredadors que utilitzen eines de comunicació per reclutar-los i explotar-los, i limitar la propagació del Material d'Abús Sexual Infantil. Basant-nos en els comentaris dels clients, grups de defensa, investigadors i altres, hem decidit prendre'ns un temps addicional en els propers mesos per recopilar informació i fer millores abans de llançar aquestes característiques de seguretat infantil d'importància crítica".

Els plans d'Apple eren llançar aquesta funció a iOS 15, iPadOS 15 i macOS Monterey a finals d'aquest any, però ara no s'ha anunciat una nova data. Per tant, no sabem quan s'implementarà aquesta funció, ni quines millores inclourà exactament Apple.

Apple anuncia noves funcions CSAM contra l’abús infantil.

Bàsicament, així és com Apple va definir aquesta funció:

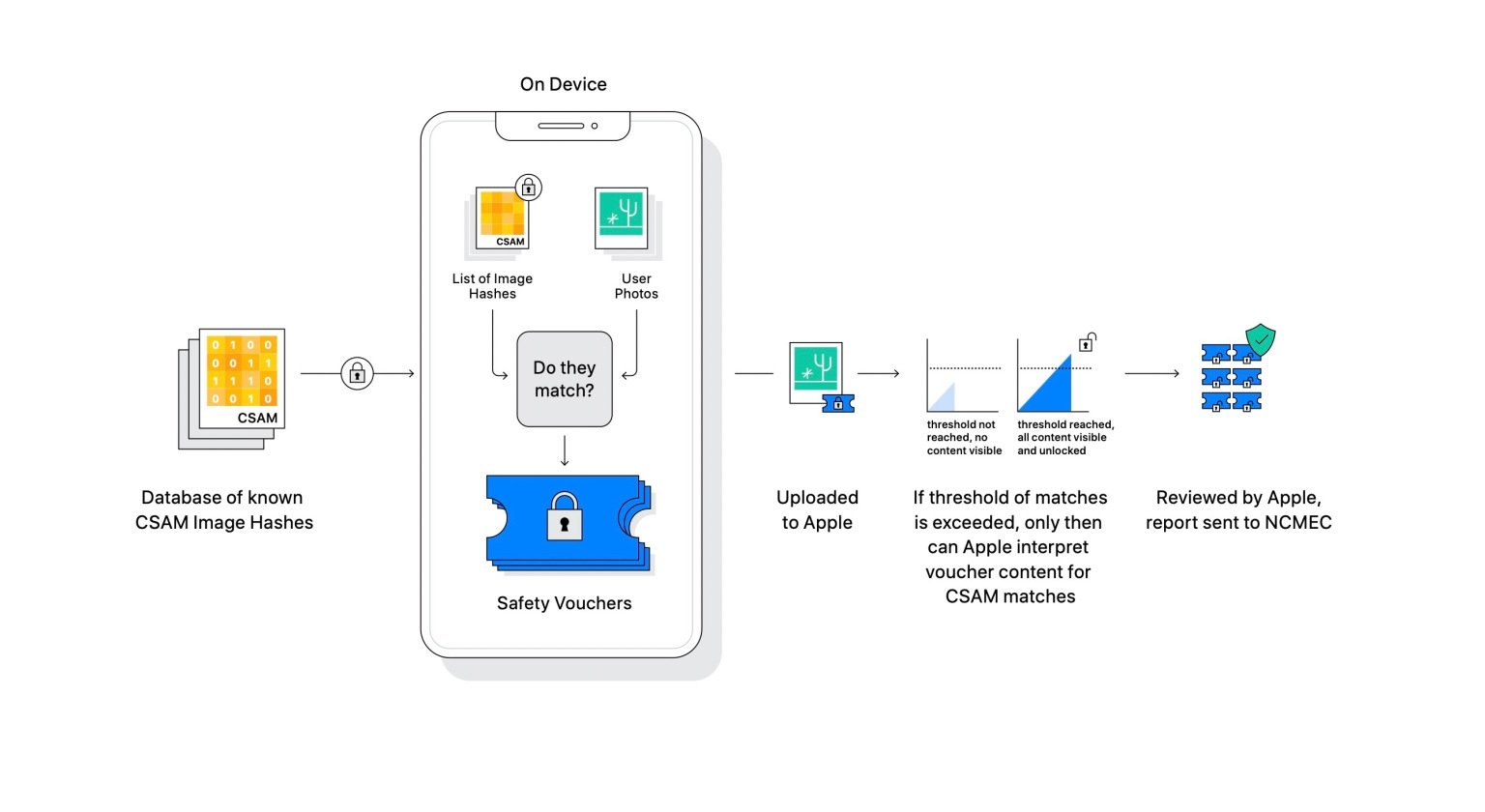

"El mètode d'Apple per detectar CSAM (Child Sexual Abuse Material) està dissenyat tenint en compte la privacitat de l'usuari. En lloc d'escanejar imatges al núvol, el sistema realitza la comparació al dispositiu utilitzant una base de dades de hashes d'imatges CSAM coneguts proporcionats per NCMEC i altres organitzacions de seguretat infantil. Apple transforma encara més aquesta base de dades en un conjunt il·legible de hashes que s'emmagatzema de forma segura als dispositius dels usuaris".

"Abans que una imatge s'emmagatzemi a Fotos d'iCloud, es realitza un procés de coincidència al dispositiu per a aquesta imatge contra els hash CSAM coneguts. Aquest procés de coincidència està impulsat per una tecnologia criptogràfica anomenada intersecció de conjunt privat, que determina si hi ha una coincidència sense revelar el resultat. El dispositiu crea un val de seguretat criptogràfic que codifica el resultat de la coincidència juntament amb dades xifrades addicionals sobre la imatge. Aquest val es carrega a Fotos d'iCloud juntament amb la imatge".

La detecció es realitza a través del filtre d'informació i comparació d'imatges d'una base de dades de CSAM i les biblioteques de l'usuari.

Veurem si a finals d'any tenim notícies noves sobre aquesta tecnologia. Cosa que, per cert, s'havia convertit en un dels principals motius pels quals els usuaris d'Android no volien l'iPhone 13.