Apple continua treballant en la seguretat, i recentment s'ha donat a conèixer un nou sistema per a la detecció de material amb aspectes d'abús infantil.

Apple anuncia noves funcions CSAM contra l’abús infantil.

Apple contra l’abús infantil

D'acord a un report esmentat fa, Apple anunciaria una nova eina amb algorismes hash per a la detecció fotogràfica de continguts relacionats a l'abús infantil. Tot això a través de un nou sistema que s'instal·laria en el dispositiu de l'usuari i que compararia les imatges amb material il·legal per trobar coincidències.

Aquest nou sistema treballaria a través d'empremtes digitals que no incompleixen amb les regles de privadesa treballades actualment per la companyia i que intervindrien en la pujada d'arxius a iCloud Photos amb la finalitat d'evitar la propagació i el resguard de material indegut.

Ara és una realitat. De manera oficial la companyia Apple ha anunciat una nova iniciativa per a la protecció de nens a iPhone, iPad i Mac. Amb la frase: "protegir els nens és una responsabilitat important". Apple anuncia 3 novetats en funció per a aquest nou avenç en seguretat.

Detecció de CSAM

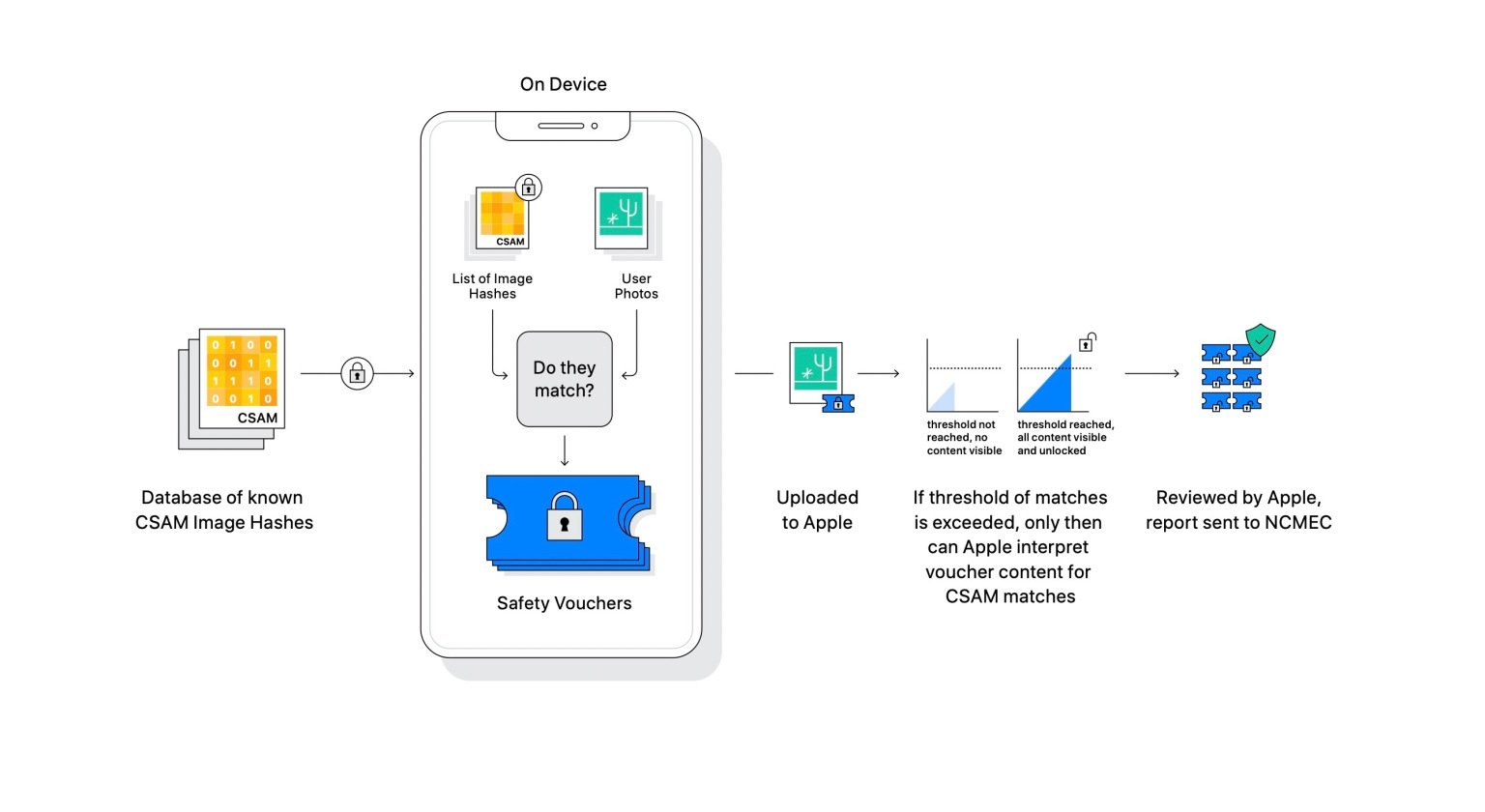

Amb CSAM Apple es refereix al contingut que mostra activitats sexualment explícites que involucren un nen. Per a això ha implementat un nou mètode de reconeixement per al contingut de l'usuari amb la finalitat de trobar coincidències a través del procés de hashes esmentat anteriorment i així poder reportar casos de CSAM al Centre Nacional per a Nens Desapareguts i Explotats.

Abans que una imatge s'emmagatzemi a Fotos d'iCloud, es realitza un procés de comparació al dispositiu per a aquesta imatge amb el conjunt il·legible de hashes CSAM coneguts. Aquest procés de coincidència està impulsat per una tecnologia criptogràfica anomenada intersecció de conjunts privats, que determina si hi ha una coincidència sense revelar el resultat. La intersecció de conjunts privats (PSI) permet a Apple saber si un hash d'imatge coincideix amb els hash d'imatge CSAM coneguts, sense aprendre res sobre els hash d'imatge que no coincideixen. PSI també evita que l'usuari sàpiga si hi va haver una coincidència.

Perquè no existeixi error, Apple fa ús d'una nova tecnologia anomenada Umbral, la qual filtra i s'assegura que la detecció sigui correcta i no es pugui crear una falsa troballa de CSAM. D'acord amb les dades d'Apple, el sistema té una taxa d'error de menys d'1 en 1 bilió de comptes per any.

La detecció es realitza a través del filtre d'informació i comparació d'imatges d'una base de dades de CSAM i les biblioteques de l'usuari.

Missatges

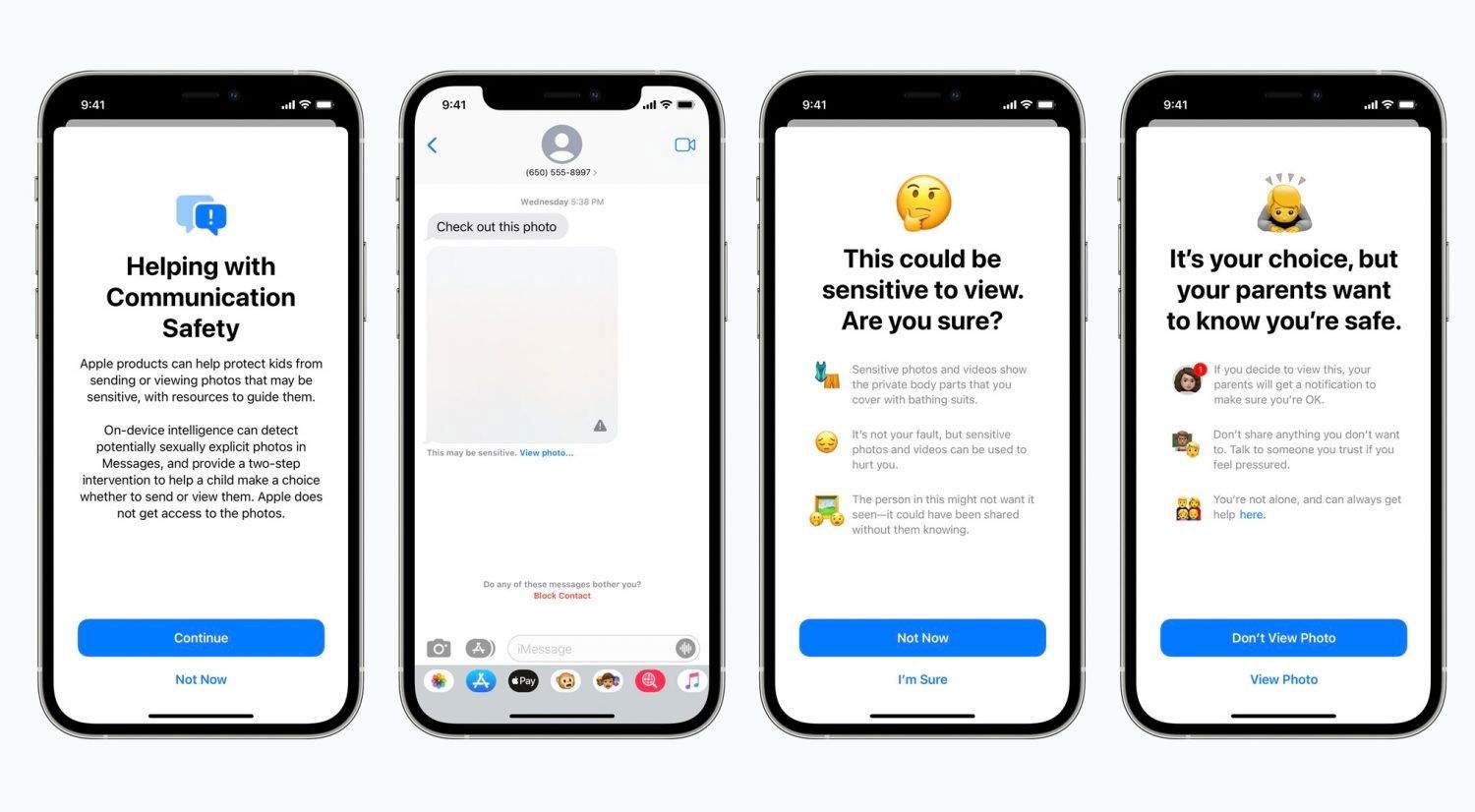

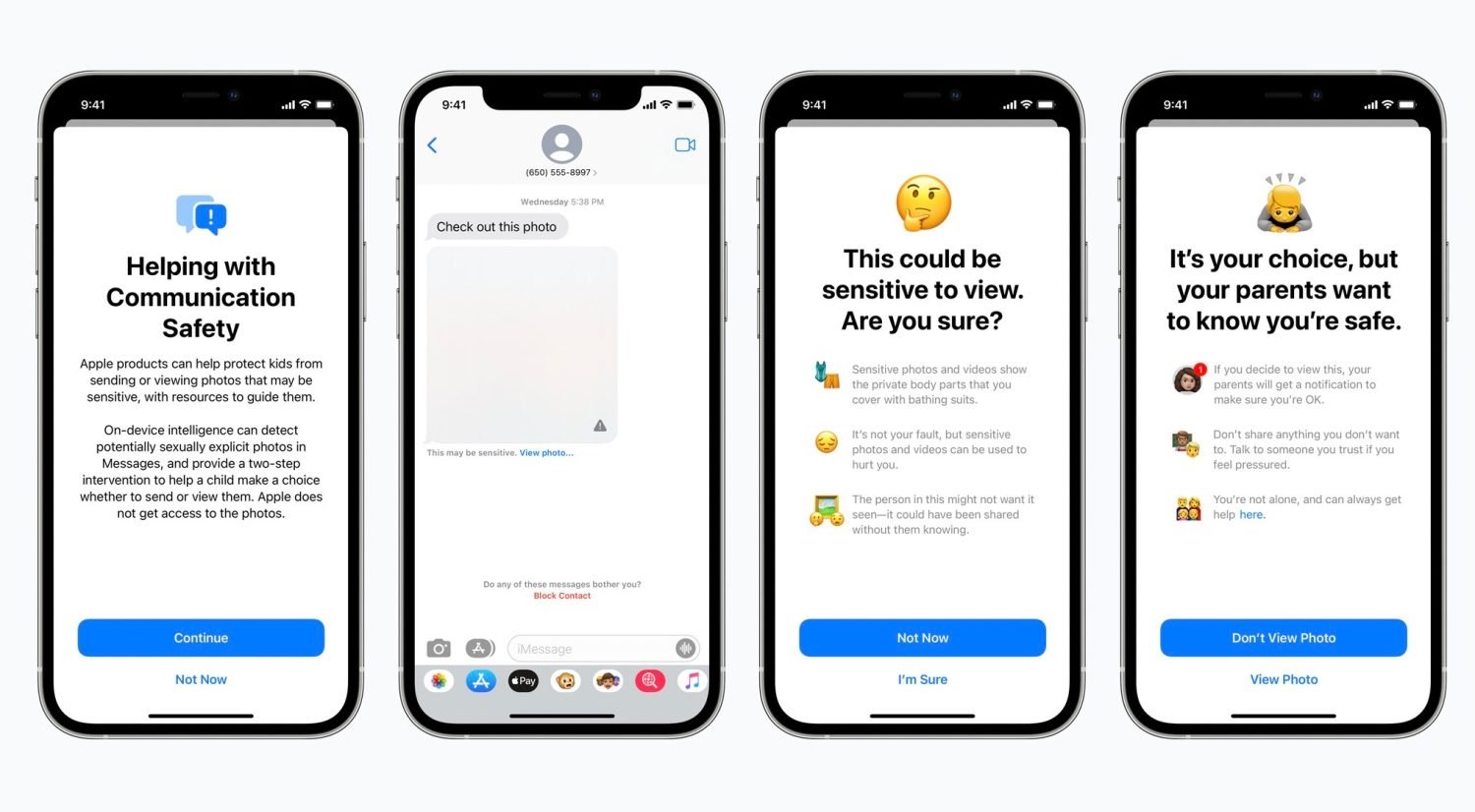

Una de les novetats més importants per a la seguretat de menors arriba amb els missatges. Ara els nens que comptin amb dispositius Apple lligats a una família per mitjà d'iCloud tindran avisos d'advertència en els seus missatges en rebre o enviar alguna imatge que pugui ser sexualment explícita.

Així és, cada cop que un menor rebi una imatge que pugui ser sensible, apareixerà borrosa i l'app enviarà una notificació d'advertència de seguida. En aquesta advertència s'anunciarà al menor per què és indeguda i en cas d'accedir a veure-la el pare de família d'iCloud rebrà una notificació "per assegurar-se que estàs bé".

El mateix succeirà quan el menor intenti enviar una foto considerada indeguda per ser sexualment explícita.

Apple fa esment que el sistema comença un aprenentatge automàtic que ajuda a determinar els continguts sensibles sense necessitat de trencar l'acord de xifratge d'extrem a extrem amb què compta el servei, per la qual cosa les converses seguiran sent privades, però més segures per als nens.

Els pares podran tenir més control sobre els seus fills a través de la família a iCloud.

Cercas i Siri

Finalment les funcions de Siri i cerca dels dispositius Apple han estat adaptades per oferir ajuda sobre el tema d'abús infantil.

Apple també està ampliant l'orientació en Siri i Cerca en proporcionar recursos addicionals per ajudar els nens i pares a mantenir-se segurs en línia i obtenir ajuda en situacions insegures. Per exemple, els usuaris que preguntin a Siri com poden denunciar l'abús sexual infantil o infantil o l'explotació infantil seran dirigits a recursos sobre on i com presentar una denúncia.

Siri i Search també s'estan actualitzant per intervenir quan els usuaris realitzen cerques de consultes relacionades amb CSAM. Aquestes intervencions explicaran als usuaris que l'interès en aquest tema és nociu i problemàtic, i proporcionaran recursos dels socis per obtenir ajuda amb aquest tema.

Siri i la funció de cerca també oferiran ajuda i informació sobre l’abús infantil.

Aquestes novetats s'implementaran en les actualitzacions d'iOS 15, iPadOS 15 i macOS Monterey, començaran als Estats Units i s'expandiran com més aviat millor a altres regions.

No hi ha dubte que aquest és un gran pas per al benestar social, per al control i cura dels menors que utilitzen dispositius i alguna cosa que de manera desinteressada podria repercutir per a l'èxit d'Apple que avui dia s'ha tornat la sisena companyia que més diners guanya en l'actualitat.