Apple ha anunciat una nova tecnologia destinada a detectar fotos d'abús infantil a les biblioteques de fotos d'iCloud dels usuaris. És a dir, Apple analitzarà les fotos que pugem a iCloud o que enviem per iMessage a la recerca de fotografies que puguin estar relacionades amb l'abús infantil.

Una funció polèmica

Sent Apple una de les empreses que més es preocupa per la privacitat dels usuaris, una mesura com aquesta pot posar en dubte tot aquest esforç. Tanmateix, la tecnologia utilitzada per Apple promet mantenir la privacitat fora de perill, llevat que es trobin fotos d'abús infantil, Child Sexual Abuse Material en anglès, o CSAM.

Com detecta Apple el CSAM, atempta contra la nostra privadesa?

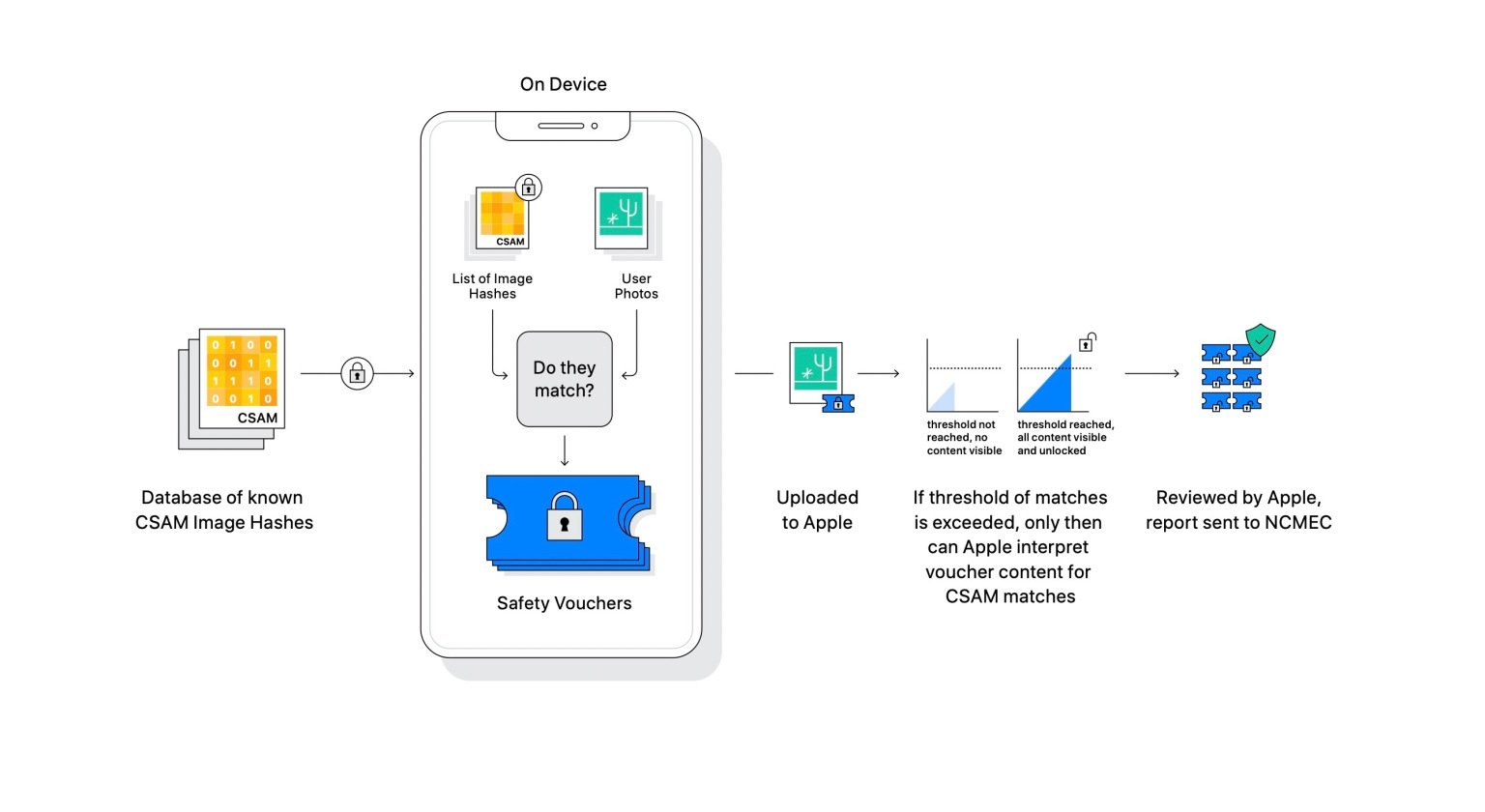

Apple descriu que el que essencialment realitzaran és analitzar les imatges que es pugin a iCloud i comparar-les amb una base de dades d'imatges conegudes de CSAM per veure si hi ha alguna coincidència. Tot el procés es realitza en el propi dispositiu, i Apple transforma les imatges en hashes que s'emmagatzemen de forma segura al nostre dispositiu.

Una funció criptogràfica hash, coneguda simplement com a "hash", és un algoritme matemàtic que transforma qualsevol bloc de dades en una nova sèrie de caràcters diferent. De manera que és impossible que Apple pugui veure les teves imatges, només quan salta una coincidència Apple rep l'avís i comprova manualment si existeix una veritable coincidència, i en cas afirmatiu ho posa en mans de les autoritats.

La detecció es realitza a través del filtre d'informació i comparació d'imatges d'una base de dades de CSAM i les biblioteques de l'usuari.

Així és com explica Apple aquesta tecnologia:

"Abans que una imatge s'emmagatzemi a Fotos d'iCloud, es realitza un procés de coincidència al dispositiu per a aquesta imatge contra el conjunt il·legible de hashes CSAM coneguts. Aquest procés de coincidència està impulsat per una tecnologia criptogràfica anomenada intersecció de conjunt privat, que determina si hi ha una coincidència sense revelar el resultat. La intersecció de conjunt privat (PSI) permet a Apple saber si un hash d'imatge coincideix amb els hashes d'imatge CSAM coneguts, sense aprendre res sobre els hashes d'imatge que no coincideixen. PSI també impedeix que l'usuari aprengui si hi va haver una coincidència".

És a dir, les nostres fotos estaran fora de perill i ningú no les podria veure, a menys que ens trobem amb falsos positius. Tot i que Apple va assegurar que hi hauria d'haver diverses imatges que coincideixin a la biblioteca de l'usuari perquè s'enviï l'informe. No obstant això, això encara té altres riscos.

El principal problema del sistema, del que es fa ressò la Electronic Frontier Foundation, és que al cap i a la fi, Apple està obrint una porta del darrere per escanejar el nostre dispositiu abans que les nostres fotos s'enviïn.

Fotos a l’iPhone

Apple utilitza la base de dades amb hashes a revisar d'un tercer, usen el Child Sexual Abuse Material (CSAM) del National Center for Missing & Exploited Children. Però igual en altres països, alguns governs totalitaris poden ficar fotos diferents per detectar dissidents o localitzar manifestants. A fi de comptes, per molt que confiïm en Apple, les dades s'obtenen d'un tercer.

Malgrat aquestes possibles fallades, cal dir que aquesta és una tecnologia que porta molts anys en ús en moltes plataformes de contingut. Potser a alguns no els agradi i altres pensin que és una bona mesura, però que Apple hauria d'haver-la mantingut en secret, ja que ara aquestes persones estan en avís.

Sigui com sigui, Apple sembla estar orgullosa de la seva tecnologia. En un memoràndum intern Sebastien Marineau-Mes, vicepresident de programari d'Apple, s'ha mostrat molt content amb aquesta novetat que arribarà a finals d'any.

"Mantenir els nens segurs és una missió molt important. A la manera d'Apple, perseguir aquest objectiu ha requerit un profund compromís multifuncional, que abasta Enginyeria, GA, HI, Legal, Màrqueting de Productes i Relacions Públiques. El que anunciem avui és el producte d'aquesta increïble col·laboració, que ofereix eines per protegir els nens, però també mantenir el profund compromís d'Apple amb la privadesa de l'usuari".

Aquest tipus d'accions són difícils de valorar, i no hi ha una forma realment correcta de fer les coses. Tanmateix és d'aplaudir que Apple intenti ajudar contra l'abús infantil a la vegada que no compromet la privacitat dels seus usuaris.