Des de fa anys Apple s'ha beneficiat de la robòtica industrial, aprofitant-la en el reciclatge d'iPhone, amb el seu model Daisy o com pensa fer-ho a mitjà termini en l'assemblatge dels nous iPhones. Però ara, la companyia dirigeix la seva mirada cap a l'ensenyament de la interacció física als robots.

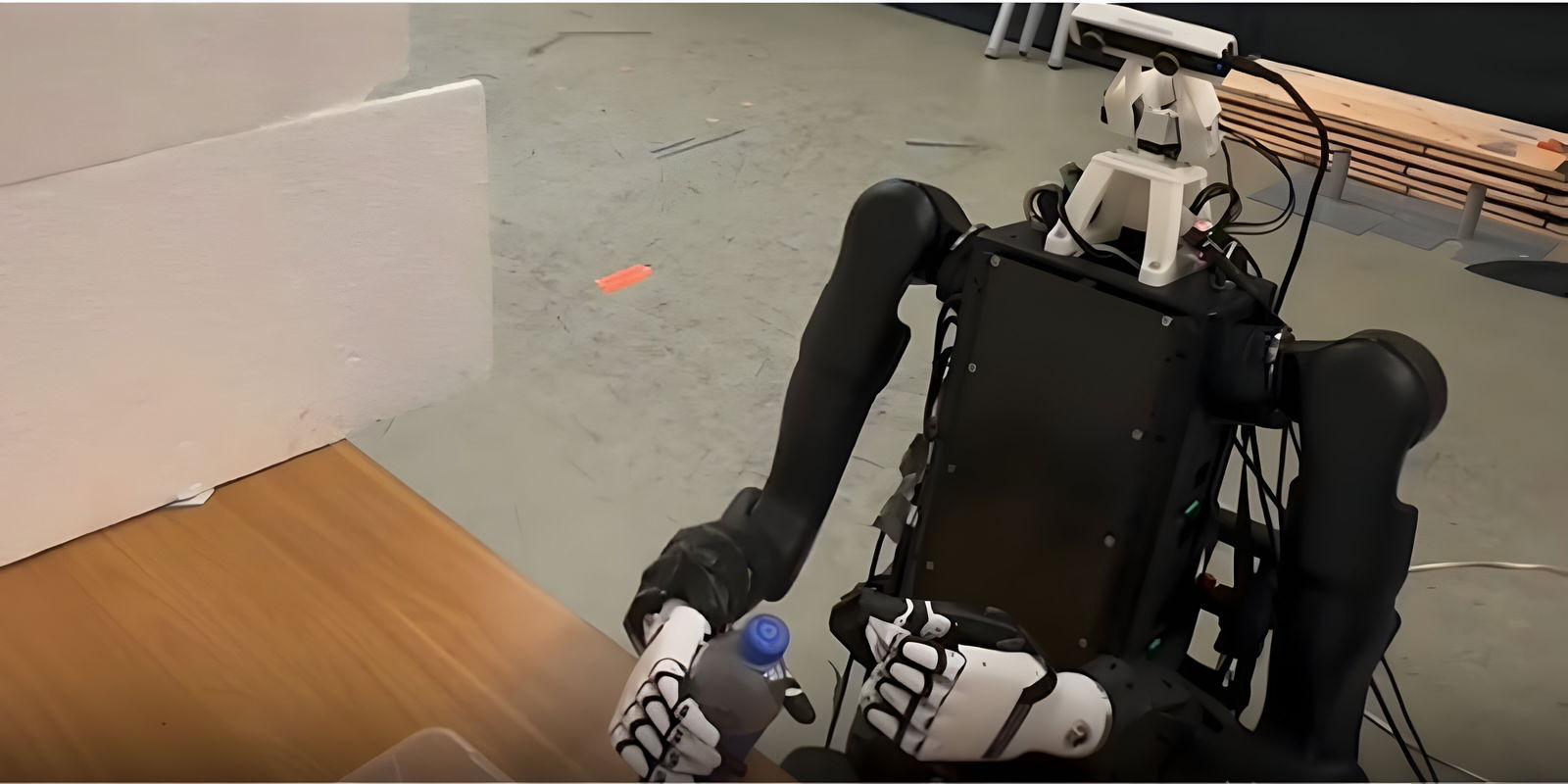

Un recent i revelador article d'investigació titulat "Humanoid Policy ∼ Human Policy" revela una col·laboració multidisciplinària liderada per Apple que proposa un mètode innovador per entrenar robots humanoides utilitzant la intel·ligència artificial i, sorprenentment, l'Apple Vision Pro com a eina clau de captura de dades.

Apple ja frega la ciència-ficció

Els investigadors van generar un mètode d'aprenentatge més eficient per entrenar els robots en tasques complexes

El projecte, que uneix l'experiència d'Apple amb el coneixement acadèmic del MIT, Carnegie Mellon, la Universitat de Washington i la Universitat de Califòrnia a San Diego, se centra en una pregunta fonamental: com dotar els robots de la capacitat de manipular objectes i desenvolupar-se en el món físic de manera tan natural com ho fem els humans? La resposta que proposen els investigadors rau en l'aprenentatge a partir de l'observació en primera persona.

Per alimentar els seus models d'IA, l'equip va complir diverses etapes:

1.Recopilació de dades PH2D

L'equip d'investigació va crear un extens conjunt de dades anomenat PH2D. Aquest conjunt de dades va incloure:

- Més de 25.000 demostracions d'accions realitzades per humans.

- 1.500 demostracions d'accions realitzades per robots.

2.Entrenament amb HAT

- Les dades PH2D es van utilitzar per entrenar una política d'Intel·ligència Artificial unificada anomenada Humanoid Action Transformer (HAT). L'objectiu del HAT és controlar robots humanoides reals.

En aquesta etapa el desafiament era superar els problemes de l'entrenament de robots humanoides que tradicionalment es basa en demostracions de robots, però és laboriosa, costosa i difícil d'escalar.

3.Recopilació de dades humanes amb Apple Vision Pro

Aquesta va ser l'alternativa per superar l'aprenentatge amb demostracions de robots. Per a això:

- Van desenvolupar una aplicació específica per a l'Apple Vision Pro que: captura vídeos des de la càmera inferior esquerra del Vision Pro i utilitza el framework ARKit d'Apple per rastrejar el moviment del cap i la mà en 3D amb precisió.

4. Exploració d'alternativa més assequible:

Per reduir costos, també van experimentar amb una altra configuració:

- Van utilitzar un suport imprès en 3D per connectar una càmera estèreo ZED Mini a altres visors (com el Meta Quest 3). Aquesta configuració també va aconseguir un seguiment de moviment 3D similar, però a un cost menor que el Vision Pro.

Més èxits amb menys esforç

Un detall interessant de l'estudi rau en la manera en què es va abordar la disparitat de velocitat entre els moviments humans i robòtics. Atès que les persones es mouen significativament més ràpid que els robots, els investigadors van optar per reduir la velocitat de les demostracions humanes en un factor de quatre durant l'entrenament. Aquesta desacceleració va resultar ser suficient perquè el robot pogués seguir el ritme dels moviments sense necessitat d'ajustos més complexos.

En proves comparatives, aquest enfocament d'entrenament compartit va demostrar ser superior als mètodes tradicionals, permetent al robot gestionar tasques més desafiadores, incloent-hi aquelles amb les quals no s'havia trobat prèviament. Aquesta iniciativa no és la primera a explorar l'ensenyament a robots mitjançant l'observació humana, però com succeeix quan Apple s'hi involucra, la promesa d'una execució refinada i una potencial escalabilitat sovint marca un punt d'inflexió.