Últimament han sortit a la llum molts rumors sobre com es planteja Apple la introducció de la intel·ligència artificial en el seu ecosistema de productes. S'assegurava que Apple estava treballant en novetats d'IA generativa amb un model de llenguatge basat en Ajax. Ara la firma de Cupertino ha presentat la seva pròpia IA: ReALM.

La notícia ha arribat poc després que es revelés que Apple podria associar-se amb Google per integrar Gemini a iOS 18 i hagi mantingut converses amb OpenAI, els creadors de ChatGPT. Així mateix, la companyia californiana també ha adquirit una sèrie de startups relacionades amb la indústria de la intel·ligència artificial.

Sigui com sigui, el model de llenguatge ReALM d'Apple ja ha estat presentat pels seus desenvolupadors. I segons la companyia, és més ràpid i eficient que ChatGPT en algunes operacions.

ReALM: tot el que necessites saber sobre la IA d'Apple

Tot apunta que ReALM serà presentat oficialment durant la WWDC 2024 al juny. El nou model de llenguatge ha estat revelat al món en exclusiva per VentureBeat i ha estat batejat com a ReALM – Resolució de Referència Com a Model de Llenguatge per les seves sigles en anglès.

El nou sistema d'intel·ligència artificial d'Apple és capaç de comprendre el context de diferents referències d'elements visuals en una pantalla, convertir imatges en text i produir interaccions més naturals i conversacionals amb un assistent de veu.

L'equip d'investigació d'IA d'Apple ha assegurat que ReALM és més ràpid i eficient que GPT-4 en la assimilació de dades contextuals. A més, han volgut donar a conèixer algunes de les pautes bàsiques en el desenvolupament del seu model de llenguatge.

"Ser capaç de comprendre context, incloent referències, és essencial per a un assistent conversacional. Habilitar que l'usuari pregunti qüestions sobre el que veuen a la seva pantalla és un pas crucial per assegurar una experiència de mans lliures en els assistents de veu."

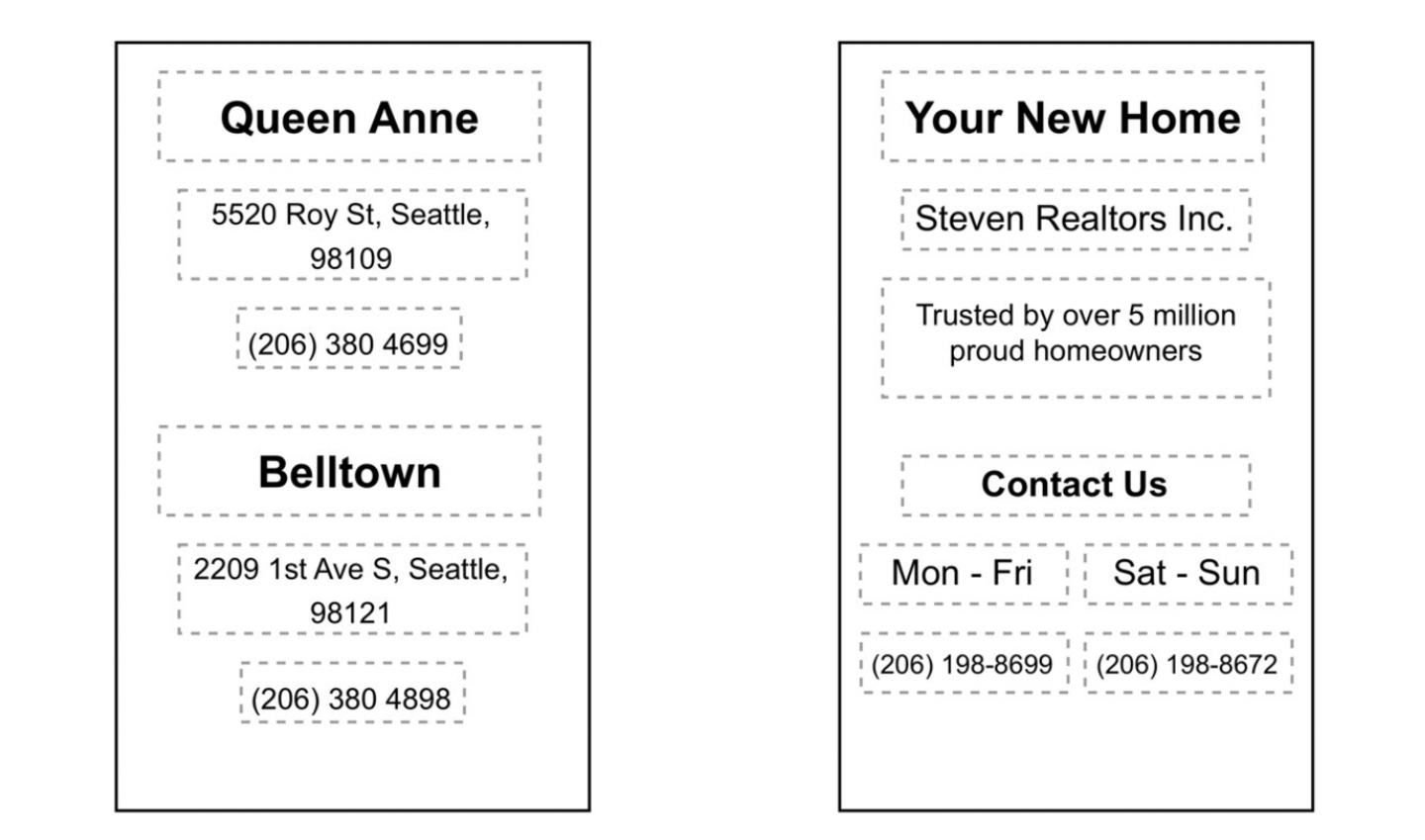

Els ordinadors no poden interpretar les imatges de la mateixa manera en què ho fa un humà. Però Apple ha trobat la solució amb el seu model de llenguatge ReALM, reconstruint tot el context d'una pantalla en text.

Representació d'obtenció de dades de text en una imatge

ReALM ofereix un rendiment similar a GPT-4 usant molts menys paràmetres. I és més eficient en incrementar els seus paràmetres.

"Hem demostrat grans millores sobre un sistema existent amb funcionalitat similar a través de diferents tipus de referències, amb el nostre petit model obtenint millores del 5% en referències en pantalla. Els nostres models més grans tenen un rendiment substancialment millor que GPT-4."

Tot i que encara queda molta feina per fer. ReALM té les seves limitacions a l'hora de gestionar referències visuals més complexes, com ara distingir entre múltiples imatges.

La intel·ligència artificial ha ressorgit amb molta força al llarg dels últims mesos, concretament des de la presentació de ChatGPT en la cerca de Bing per part de Microsoft. Des d'aleshores, totes les companyies de tecnologia competeixen per desenvolupar el model de llenguatge més avançat. Una cursa d'IA a la qual Apple per fi s'ha sumat. Tot i que Tim Cook ha assenyalat en una entrevista amb Dua Lipa que Apple ja havia implementat moltes funcions d'IA a l'iPhone i en altres dispositius.

"Si ets un client d'Apple avui, la IA és en tots els productes que produïm d'una manera molt significativa, però no l'etiquetem com a tal."

La IA del model de llenguatge ReALM té molt bona pinta i farà que Siri i altres elements dels sistemes operatius d'Apple ofereixin grans beneficis als usuaris. Què et sembla aquesta interessant novetat sobre Apple?