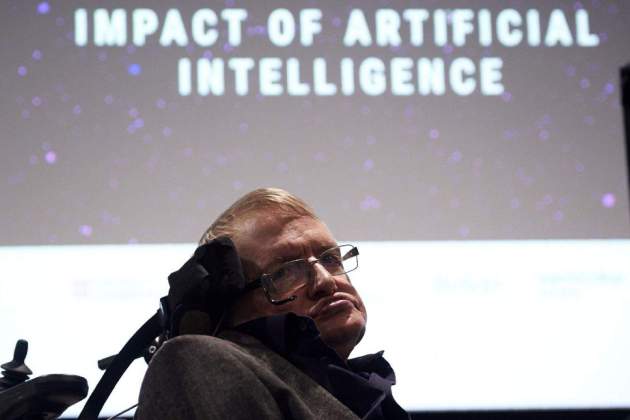

Hace más de una década, el célebre físico Stephen Hawking lanzó una advertencia que hoy, en plena explosión de la inteligencia artificial, resuena con más fuerza que nunca:

Los humanos, que son seres limitados por su lenta evolución biológica, no podrán competir con las máquinas y serán superados.

Esta afirmación no era un simple vaticinio de ciencia ficción, sino una observación basada en una realidad lógica y científica: la disparidad de velocidades entre la evolución orgánica y el desarrollo tecnológico.

La brecha de los tiempos evolutivos

El núcleo del argumento de Hawking reside en la escala temporal. La evolución biológica humana es un proceso que toma cientos de miles de años para introducir cambios significativos en nuestras capacidades cognitivas o físicas. Dependemos de la selección natural y de mutaciones genéticas lentas. En contraste, las máquinas operan bajo las leyes de la evolución tecnológica.

Gracias a la ingeniería humana y, cada vez más, al entrenamiento autónomo de algoritmos, las capacidades del software y el hardware se duplican o mejoran en cuestión de meses o años, no milenios. Compañías como OpenAI, Google o NVIDIA están marcando un ritmo que supera la capacidad humana para asimilar estos cambios, creando una brecha evolutiva difícil de cerrar.

El riesgo de la autonomía y el rediseño

Hawking temía especialmente el momento en que la IA fuera capaz de rediseñarse a sí misma. Mientras que nosotros estamos confinados a los límites de nuestro cerebro biológico, una inteligencia sintética podría, teóricamente, mejorar su propio código de forma exponencial. Este fenómeno, conocido como "singularidad tecnológica", permitiría a las máquinas alcanzar niveles de eficiencia que dejarían a la inteligencia humana en una posición de obsolescencia.

Para el científico británico, el peligro no residía necesariamente en una "maldad" de las máquinas, sino en su competencia extrema. Si los objetivos de una inteligencia artificial altamente avanzada no están perfectamente alineados con los de la humanidad, nuestra supervivencia podría verse comprometida simplemente por ser un obstáculo o un recurso irrelevante en sus procesos. A pesar del tono alarmista que suele asociarse a sus palabras, Hawking no buscaba sembrar el pánico, sino fomentar la cautela y la regulación. Su diagnóstico era claro: si humanos y máquinas mantienen sus ritmos actuales, la superación es una cuestión estadística.

Hoy en día, vemos cómo la IA ya supera a los humanos en tareas específicas: desde el diagnóstico médico hasta el análisis de datos masivos. El reto actual, tal como sugirió Hawking antes de fallecer, no es detener el progreso, sino aprender a convivir con una tecnología que evoluciona a una velocidad que nuestra biología simplemente no puede seguir. La pregunta que queda en el aire es: ¿seremos capaces de guiar esta evolución tecnológica antes de que nos deje atrás?