Google podría haber terminado de un plumazo con la crisis de los componentes que está haciendo que los precios de la memoria RAM y del almacenamiento SSD estén por las nubes. El principal problema con estos componentes se debe a su escasez, ya que los centros de datos para que la IA funcione necesitan altas cantidades de memoria RAM. Sin embargo, un algoritmo de Google promete reducir el consumo de memoria hasta en seis veces.

TurboQuant puede revolucionar la IA

Google podría revolucionar el campo de la inteligencia artificial con su nuevo enfoque, TurboQuant. Este método promete una mejora significativa en la eficiencia, lo que podría tener un impacto considerable en el mercado tecnológico: menor consumo de memoria, menor dependencia del hardware y modelos mucho más rápidos.

El componente clave de TurboQuant es el kv-cache, que actúa como la memoria a corto plazo de los modelos de IA. A medida que el modelo procesa más información, el kv-cache crece rápidamente, convirtiéndose en uno de los principales cuellos de botella: consume mucha memoria, ralentiza el sistema y encarece enormemente el uso de IA a gran escala.

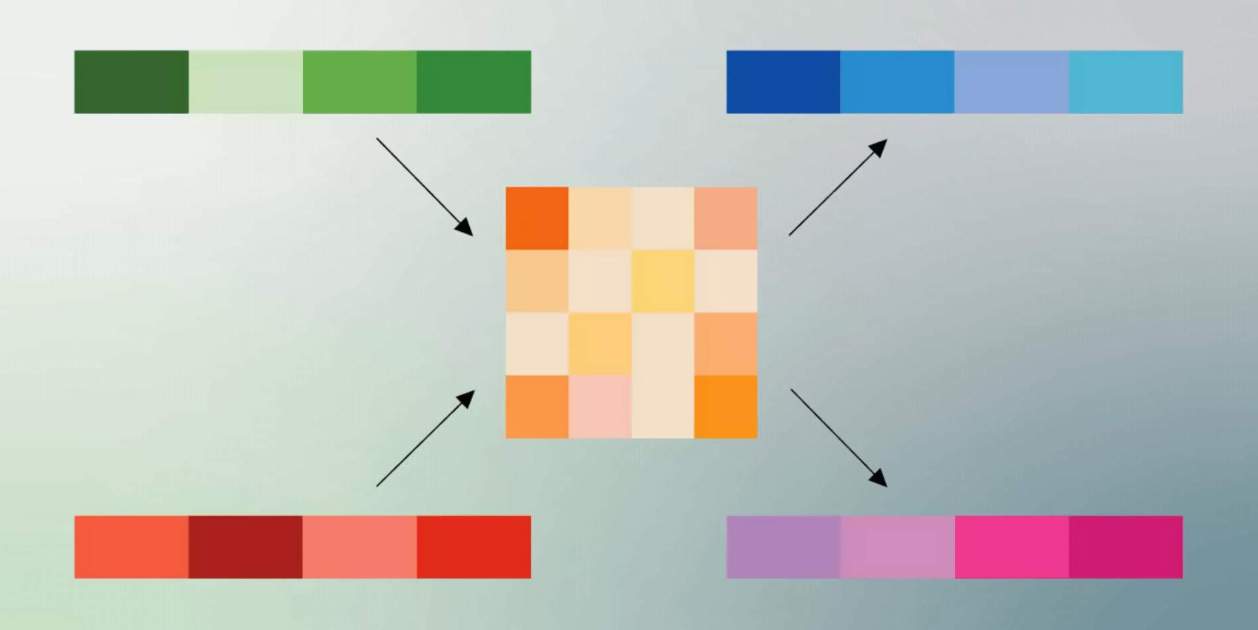

El avance de Google reside en la compresión extrema de esta memoria. Tradicionalmente, las representaciones se almacenan en 16 o 32 bits, pero TurboQuant las reduce a tan solo 3 bits, sin una pérdida significativa de precisión. Esto permite reducir el consumo de memoria hasta 6 veces y acelerar el rendimiento hasta 8 veces utilizando la misma infraestructura de GPUs.

Si TurboQuant se implementa de forma masiva, el impacto podría ser enorme. No solo abarataría considerablemente el entrenamiento y la ejecución de modelos de IA, sino que también reduciría la necesidad de grandes inversiones en hardware, especialmente en memoria, que ha sido uno de los principales motores del auge reciente del sector.

En resumen, si TurboQuant cumple sus promesas, podríamos estar ante un punto de inflexión: una IA más eficiente, más accesible y mucho menos dependiente de los recursos que actualmente inflan el mercado.